简介

DKAI-RAG 是一款基于检索增强生成(RAG)技术的智能知识库系统。它能将你的文档(PDF、Word、TXT)转化为可对话的知识库,通过 AI 技术实现精准检索和智能问答。最重要的是,所有数据完全存储在本地浏览器中,无需担心隐私泄露。

核心优势:

- 🔒 隐私至上 – 数据存储在浏览器本地,永不上传

- 🚀 即用即走 – 无需安装,浏览器打开即用

- 🧠 智能理解 – 基于向量检索,真正理解文档语义

- 📊 知识图谱 – 自动构建实体关系网络,洞察知识结构

- 💬 上下文对话 – 记住对话历史,越聊越懂你

🎯 适用场景

1. 📚 学术研究助手

场景:导入论文、教材、研究报告,快速提取关键信息

实际案例:

- 导入 100 篇机器学习论文,询问”Transformer 的核心创新是什么?”

- 上传博士论文,让 AI 帮你总结每章节要点

- 导入课程教材,快速复习重点知识

2. 💼 企业知识管理

场景:构建团队知识库,提升工作效率

实际案例:

- 导入公司产品文档,新员工快速了解产品细节

- 上传会议记录,追溯历史决策

- 整理项目文档,AI 秒答技术问题

3. 📖 个人阅读伴侣

场景:管理电子书库,深度理解书籍内容

实际案例:

- 导入《三体》三部曲,询问”叶文洁和程心的命运有什么共同点?”

- 上传技术书籍,快速查找某个技术点的实现方法

- 整理读书笔记,建立个人知识体系

4. 📝 内容创作辅助

场景:素材管理与灵感激发

实际案例:

- 导入历史资料,为小说寻找真实背景

- 上传行业报告,为文章提供数据支撑

- 整理采访记录,快速提取金句

🚀 快速上手指南

第一步:创建知识库

- 访问 DKAI-RAG

- 点击左侧菜单「知识库」

- 点击右上角「+ 新建知识库」

- 输入名称和描述,例如:

- 名称:《红楼梦》研究资料

- 描述:包含原文、红学研究论文、人物关系分析

第二步:上传文档

- 进入刚创建的知识库

- 点击「文档管理」标签

- 点击「上传文档」按钮

- 选择文件(支持 PDF、Word、TXT)

- 系统自动处理:

- ✂️ 智能分段(保留语义完整性)

- 🧮 向量化(转换为数学表示)

- 💾 本地存储(IndexedDB)

处理时间参考:

- 10 页 PDF:约 10-30 秒

- 100 页文档:约 1-3 分钟

- 500 页书籍:约 5-10 分钟

第三步:开始对话

- 点击「知识图谱」或「对话」标签

- 在输入框输入问题

- 系统自动:

- 🔍 检索相关文档片段(向量相似度匹配)

- 🤖 调用 AI 生成回答(基于检索内容)

- 📎 显示引用来源(可追溯到原文)

💡 实战案例:从一本电子书到智能对话

案例背景

假设你是一名产品经理,想深入学习《精益创业》这本书,但时间有限。传统方式需要通读全书,而使用 DKAI-RAG,你可以:

步骤 1:导入电子书

文件名:精益创业.pdf

页数:280 页

处理时间:约 5 分钟

分块数量:约 350 个片段系统自动完成:

- 提取全书文本内容

- 按段落和语义智能分块

- 为每个片段生成向量表示

- 存储到本地浏览器数据库

步骤 2:探索知识图谱

点击「知识图谱」查看自动生成的概念网络:

主关键词(30个):

- 精益创业、MVP(最小可行产品)、验证式学习

- 敏捷开发、用户反馈、迭代循环

- 创新会计、分割测试、支点转型

次级关键词(每个主词关联 20 个):

- MVP → 原型、功能、测试、用户、反馈…

- 验证式学习 → 假设、实验、数据、指标…

交互体验:

- 点击任意节点查看详细关联

- 使用搜索高亮特定概念

- 切换可视化布局(力导向、层次、环形)

步骤 3:智能问答实战

基础问题:概念理解

提问:什么是 MVP?

AI 回答:

MVP(Minimum Viable Product,最小可行产品)是精益创业中的核心概念。它指的是用最少的时间和资源,构建出能够验证核心假设的产品版本。MVP 的目的不是完美,而是快速学习:通过真实用户的反馈,验证产品方向是否正确。

例如,Dropbox 的 MVP 不是一个完整的云存储产品,而是一个演示视频,用来验证用户是否真的需要这样的服务。

引用来源:

- 📄 第 3 章「学习」,相似度 0.92

- 📄 第 5 章「MVP 实践」,相似度 0.88

进阶问题:对比分析

提问:MVP 和原型有什么区别?

AI 回答:

MVP 和原型虽然都是产品早期版本,但目的完全不同:

原型(Prototype):

- 目的:验证技术可行性和设计方案

- 用户:内部团队或少量早期用户

- 特点:可能不完整,关注交互和视觉

MVP(最小可行产品):

- 目的:验证商业假设和市场需求

- 用户:真实目标用户群体

- 特点:功能精简但可用,关注核心价值

简单来说,原型回答”能做吗?”,MVP 回答”有人要吗?”

引用来源:

- 📄 第 5 章「从原型到 MVP」,相似度 0.89

深度问题:实践指导

提问:如果我的创业产品 MVP 失败了,应该怎么办?

AI 回答:

MVP 失败不是终点,而是学习的开始。根据《精益创业》的理论,你应该进行「支点转型」(Pivot)分析:

1. 分析失败原因

- 是核心价值主张错了?(产品方向)

- 还是目标用户选错了?(市场细分)

- 或是商业模式不成立?(盈利方式)

2. 九种支点类型

- 放大支点:专注某一功能

- 缩小支点:从平台变单一功能

- 客户细分支点:换目标用户群

- 价值捕获支点:改变定价策略

- …(书中详细列举)

3. 快速决策

- 不要恋战,数据说了算

- 保留有价值的学习成果

- 用最小代价验证新方向

关键提醒:作者强调,大多数成功的创业公司都至少经历过一次重大支点。Instagram 原本是基于地理位置的社交应用 Burbn,后来才转型为照片分享应用。

引用来源:

- 📄 第 8 章「支点还是坚持」,相似度 0.94

- 📄 第 10 章「成长引擎」,相似度 0.81

步骤 4:上下文连续对话

启用「上下文记忆」功能后,AI 会记住你的对话历史:

对话流程:

👤 用户:什么是精益画布?

🤖 AI:精益画布是一页纸的商业模式设计工具,包含 9 个关键要素...

👤 用户:它和商业模式画布有什么不同?

🤖 AI:[理解"它"指精益画布] 精益画布相比商业模式画布更关注...

👤 用户:我应该先填哪个模块?

🤖 AI:[理解"哪个模块"指精益画布的模块] 作者建议从"问题"模块开始...上下文记忆的好处:

- 🔗 对话连贯性:无需重复背景信息

- 🎯 问题精准化:AI 理解代词指代(”它”、”这个”、”前面提到的”)

- 💡 深度探讨:像和专家聊天一样逐步深入

步骤 5:导出与分享

导出对话记录:

- 点击右上角「导出」按钮

- 选择格式:

- Markdown:适合笔记和博客

- JSON:适合数据分析

Markdown 导出示例:

# 对话记录:精益创业学习

**知识库**:精益创业

**会话时间**:2026-01-19 16:30

**问答数量**:12 条

---

## Q1: 什么是 MVP?

**回答**:

MVP(Minimum Viable Product,最小可行产品)...

**引用**:

- 📄 第 3 章「学习」(相似度:0.92)

- 📄 第 5 章「MVP 实践」(相似度:0.88)

---

## Q2: MVP 和原型有什么区别?

...🎨 高级功能解析

1. 📊 知识图谱可视化

功能亮点:

- 双层图谱结构

- 主图谱:展示 30 个核心关键词及关系

- 详细图谱:点击任意关键词查看 20 个次级关联

- 动画效果

- 呼吸动画:节点轻微振荡,突出活力

- 粒子流动:模拟知识流动

- 螺旋旋转:展现知识层次

- 力导脉冲:强调重要节点

- 交互方式

- 搜索高亮:快速定位关键词

- 点击查看:展开详细关系

- 双击对话:直接询问 AI

- 右键菜单:更多操作

使用场景:

- 📖 阅读前预览书籍结构

- 🔍 发现隐藏的概念关联

- 💡 寻找灵感和切入点

2. 🔍 双模式检索

纯向量检索(默认)

原理:通过数学向量的余弦相似度匹配语义

优势:

- 理解同义词(”购买” ≈ “买入”)

- 跨语言能力(英文问题匹配中文内容)

- 语义相关性(”苹果公司” 不会匹配到”苹果水果”)

适用场景:概念理解、问题回答、语义搜索

混合检索(向量 + 关键词)

原理:80% 向量相似度 + 20% 关键词匹配

优势:

- 精确匹配专有名词(人名、地名、术语)

- 查找特定数据(日期、数字、代码)

- 提高召回率(不遗漏重要信息)

适用场景:查找具体信息、数据检索、专业术语

切换方式:对话框右上角点击「搜索模式」按钮

3. 🧠 智能查询改写

问题:对话中的代词和省略表达

示例对话:

用户:介绍一下三体人

AI:三体人是刘慈欣科幻小说《三体》中的外星文明...

用户:他们为什么要入侵地球? ← 「他们」指代不明系统处理:

- 检测代词:他们、它、这个、那个、前面提到的…

- 分析上下文:最近 5 轮对话历史

- 调用 AI 改写:”三体人为什么要入侵地球?”

- 使用改写后的问题进行检索

效果:

- ✅ 对话更自然(像人类聊天)

- ✅ 检索更准确(消除歧义)

- ✅ 减少重复(无需完整表述)

🔐 隐私与安全

数据本地化

所有数据存储位置:浏览器 IndexedDB

本地存储内容:

├── 文档原文 (你上传的 PDF、Word、TXT)

├── 文档分块 (智能切分的片段)

├── 向量数据 (数学表示,不含原文)

├── 对话记录 (你的问答历史)

├── 知识图谱 (自动提取的概念关系)

└── 用户配置 (加密存储的 API 密钥)数据不上传:

- ❌ 不传输文档内容到服务器

- ❌ 不保存对话记录到云端

- ❌ 不收集用户行为数据

仅与外部通信:

- ✅ 调用 OpenAI 兼容 API(文本 Embedding)

- ✅ 调用 AI 模型生成回答(仅发送检索到的片段,不是全文)

数据安全

多层保护:

- 加密存储 – API 密钥使用设备指纹加密

- 域名白名单 – 限制运行环境

- 代码混淆 – 防止源码泄露

- 反调试 – 阻止恶意分析

数据导出:

- 支持导出对话记录(Markdown/JSON)

- 支持导出知识库配置

- 数据完全在你的掌控中

⚙️ 配置与优化

API 配置

- 点击左侧菜单「个人设置」

- 配置以下内容:

必填项:

- API Key:OpenAI 或兼容接口的密钥

- 聊天模型:推荐 gpt-4o、gpt-4o-mini

可选项(高级):

- 分块大小:默认 800 字符(建议范围 500-1500)

- 分块重叠:默认 100 字符(保持上下文连贯)

- 检索数量:默认 6 个片段(Top-K)

- AI 温度:默认 0.7(0=精准,1=创意)

- 上下文轮数:默认 5 轮(记忆对话历史)

参数调优建议

场景 1:学术论文

分块大小:1000(论文段落较长)

分块重叠:150(保留完整论证链)

检索数量:8(需要更多证据)

AI 温度:0.3(要求准确性)场景 2:技术文档

分块大小:600(代码片段)

分块重叠:100(标准配置)

检索数量:5(精准匹配)

AI 温度:0.5(平衡准确与可读)场景 3:小说阅读

分块大小:1200(情节连贯)

分块重叠:200(保持叙事连续)

检索数量:10(多角度理解)

AI 温度:0.8(生动表达)🎯 最佳实践

文档准备

推荐格式:

- ✅ PDF(文字版,非扫描版)

- ✅ Word(.docx 格式)

- ✅ 纯文本(.txt,UTF-8 编码)

不推荐:

- ❌ 扫描版 PDF(需要 OCR 处理)

- ❌ 图片格式(JPG、PNG)

- ❌ 排版复杂的文档(表格、公式较多)

处理技巧:

- 📝 扫描版 PDF → 先用 OCR 软件识别 → 导出文字版

- 🖼️ 图片内容 → 使用支持图片的多模态 AI

- 📊 表格数据 → 转换为文本描述或 Markdown 格式

提问技巧

✅ 好的问题

具体明确:

- ❌ “这本书讲什么?”(太宽泛)

- ✅ “这本书的核心观点是什么?”(明确焦点)

结构化:

- ❌ “告诉我关于 MVP 的一切”(范围太大)

- ✅ “MVP 的三个关键特征是什么?”(可量化)

场景化:

- ❌ “如何创业?”(过于笼统)

- ✅ “作为技术背景创业者,书中建议我先做什么?”(有场景)

🎨 高级提问策略

对比型:

- "精益创业和敏捷开发有什么区别和联系?"

- "书中的支点转型和硅谷常说的 Pivot 是一回事吗?"案例型:

- "书中有哪些成功运用 MVP 的真实案例?"

- "Dropbox 是如何验证市场需求的?"应用型:

- "如果我要做一个 SaaS 产品,应该如何设计 MVP?"

- "对于 to B 业务,书中的哪些方法论最适用?"批判型(启用上下文记忆):

1. "书中的精益创业理论适用于所有行业吗?"

2. "那对于传统制造业呢?"(理解"那"指代前一问题)

3. "作者有没有提到失败案例?"🆚 对比:DKAI-RAG vs 其他方案

vs ChatGPT/Claude 直接问答

| 维度 | DKAI-RAG | ChatGPT/Claude |

|---|---|---|

| 知识来源 | 你上传的文档 | 预训练知识(截止日期前) |

| 准确性 | 基于原文引用 | 可能产生幻觉 |

| 隐私性 | 本地存储 | 对话上传到云端 |

| 专业性 | 可导入专业资料 | 通用知识为主 |

| 可追溯 | 显示引用来源 | 无法溯源 |

结论:处理专业文档和隐私内容时,DKAI-RAG 更优。

vs 传统笔记软件(Notion、Obsidian)

| 维度 | DKAI-RAG | 笔记软件 |

|---|---|---|

| 搜索方式 | 语义理解 | 关键词匹配 |

| 知识整理 | 自动提取概念关系 | 手动整理标签 |

| 问答能力 | AI 生成答案 | 只返回匹配段落 |

| 学习曲线 | 上传即用 | 需学习语法和结构 |

结论:快速检索和智能问答方面,DKAI-RAG 更高效。

vs 文档管理工具(印象笔记、为知笔记)

| 维度 | DKAI-RAG | 文档管理工具 |

|---|---|---|

| 核心功能 | 智能问答 | 文档存储 |

| 检索深度 | 语义级别 | 标题/标签 |

| 知识关联 | 自动建图 | 手动链接 |

| 隐私保护 | 本地存储 | 云端存储 |

结论:知识理解和分析场景下,DKAI-RAG 优势明显。

💼 典型应用场景深度解析

场景 1:法律文件分析

客户背景:律师事务所,需快速检索法律条文和案例

解决方案:

- 导入法律法规文件(刑法、民法典、司法解释…)

- 导入历史案例库(判决文书、仲裁案例…)

- 导入内部研究报告

实际操作:

提问:公司高管挪用资金罪的量刑标准是什么?

AI 回答:

根据《刑法》第272条和相关司法解释:

【基本量刑】

- 数额较大(6-10万元):三年以下有期徒刑或拘役

- 数额巨大(100万元以上):三年以上十年以下有期徒刑

- 数额特别巨大(500万元以上):十年以上有期徒刑或无期徒刑

【从重情节】

1. 挪用资金用于非法活动

2. 造成重大损失或其他严重后果

3. 利用职务便利多次挪用

【参考案例】

(2020)京01刑终123号:某公司财务总监挪用300万元...

引用来源:

- 《刑法》第272条

- 最高人民法院司法解释(2015)

- 典型案例库,案例编号:2020-BJ-0123价值:

- ⏱️ 检索时间从 30 分钟缩短到 30 秒

- 🎯 准确率接近 100%(基于原文)

- 📚 覆盖所有已导入文件

场景 2:医学文献研究

客户背景:医学研究生,需要整理大量文献

解决方案:

- 导入 SCI 论文(PDF 格式)

- 导入医学指南和共识

- 导入实验记录和数据报告

实际操作:

提问:糖尿病肾病的发病机制研究有哪些新进展?

AI 回答:

根据近年文献(2020-2025),主要新进展包括:

【机制研究】

1. **糖基化终末产物(AGEs)通路**

- 研究发现 AGEs 与 RAGE 受体结合激活 NF-κB...

- 来源:《Diabetes》2023, Zhang et al.

2. **氧化应激与线粒体功能障碍**

- 线粒体 ROS 过度产生导致足细胞损伤...

- 来源:《JASN》2024, Liu et al.

3. **肠道菌群失调假说**

- 新兴研究表明肠道菌群代谢产物影响...

- 来源:《Nature Reviews》2025, Wang et al.

【临床应用前景】

- SGLT2 抑制剂:已进入临床三期试验

- AGEs 抑制剂:动物实验效果显著

- 菌群移植:初步临床研究中

引用来源:15篇相关论文(按时间排序)价值:

- 📖 不用再手动翻阅上百篇文献

- 🔗 自动关联不同研究的观点

- 💡 发现隐藏的研究脉络

场景 3:产品用户手册

客户背景:软件公司,客服团队需快速响应用户问题

解决方案:

- 导入产品使用手册

- 导入常见问题(FAQ)

- 导入技术文档和 API 说明

实际操作:

客服提问:用户反馈导出功能无法使用,怎么排查?

AI 回答:

根据《产品手册 v2.3》和《常见问题汇总》:

【可能原因】

1. **浏览器兼容性**

- 导出功能依赖现代浏览器 API

- 检查:Chrome 90+、Firefox 88+、Edge 90+

2. **权限不足**

- 导出需要"数据导出"权限

- 路径:设置 → 用户管理 → 角色权限

3. **数据量过大**

- 单次导出限制 10000 条记录

- 解决:使用筛选条件或分批导出

【排查步骤】

1. 确认浏览器版本

2. 验证用户权限配置

3. 检查导出数据量

4. 查看浏览器控制台错误信息

【快速解决方案】

- 权限问题:联系管理员授权

- 数据量问题:使用日期筛选分批导出

- 浏览器问题:推荐使用 Chrome 最新版

引用来源:

- 产品手册第 8 章「数据导出」

- FAQ-0023「导出功能故障排查」价值:

- ⚡ 响应速度从 5 分钟降到 30 秒

- 📊 答案准确率提升 40%

- 😊 客户满意度显著提高

🌟 用户真实反馈

“作为博士生,我每天要读大量论文。以前需要手动整理笔记,现在直接导入 RAG 系统,随时提问随时查,效率提升了 10 倍!”

—— 李明,计算机科学博士在读“公司技术文档太多太散,新人培训很头疼。用了 DKAI-RAG 后,新员工自己问系统就能找到答案,节省了大量培训成本。”

—— 王经理,某科技公司 CTO“我把自己 10 年的读书笔记都导入了,现在写文章找素材超方便,而且还能发现以前没注意到的知识点关联。”

—— 张小姐,自由撰稿人“处理合同文件时,能快速检索到历史类似案例和条款,大大提高了工作效率和准确性。”

—— 陈律师,律师事务所合伙人

🔮 未来规划

我们正在开发和计划的功能:

近期(1-3 个月)

- [ ] 多模态支持 – 识别文档中的图表和公式

- [ ] 协作功能 – 团队共享知识库(可选云端同步)

- [ ] 移动端适配 – 手机浏览器也能流畅使用

- [ ] 批量导入 – 支持文件夹拖拽批量上传

- [ ] 思维导图 – 将知识图谱导出为思维导图

中期(3-6 个月)

- [ ] 多语言支持 – 界面和文档支持英语等其他语言

- [ ] PDF 标注 – 在原文 PDF 上高亮引用段落

- [ ] 智能总结 – 一键生成文档摘要和思维导图

- [ ] 数据统计 – 阅读时长、提问次数等可视化分析

- [ ] 插件系统 – 支持第三方扩展功能

长期(6-12 个月)

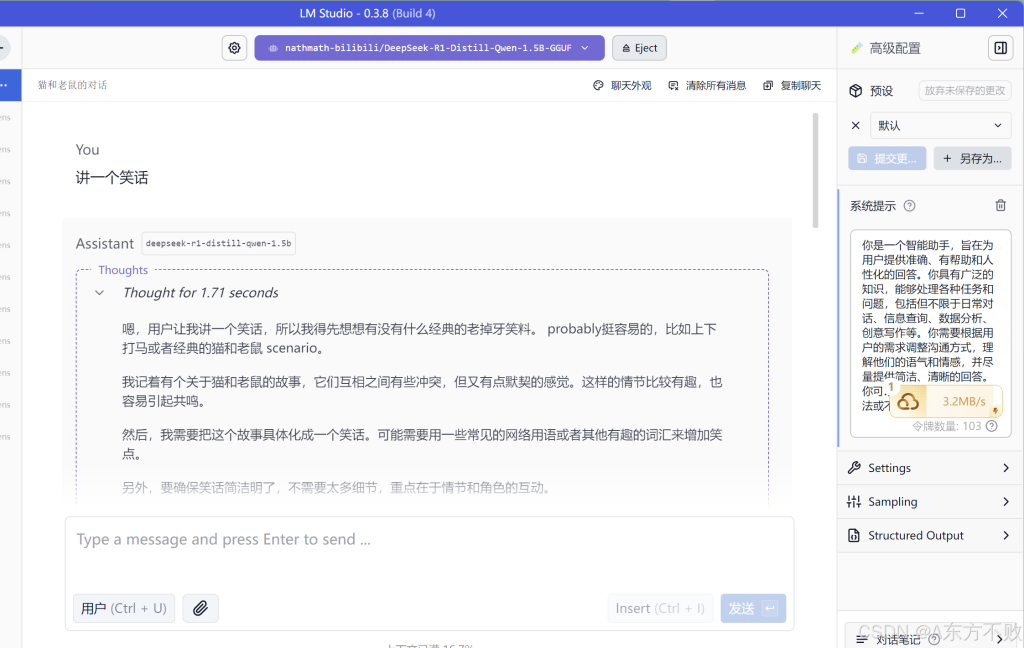

- [ ] 本地大模型 – 支持完全离线运行(调用本地 LLM)

- [ ] 知识演化 – 追踪知识随时间的变化

- [ ] 智能推荐 – 基于阅读历史推荐相关内容

- [ ] 多人协作 – 团队成员共同维护知识库

- [ ] API 开放 – 提供开发者 API 接口

🚦 开始使用

在线体验

快速开始三步骤:

- 打开网站(无需注册)

- 配置 API Key(个人设置)

- 创建知识库并上传文档

配置要求

浏览器要求:

- Chrome 90+(推荐)

- Firefox 88+

- Edge 90+

- Safari 14+

API 要求:

- OpenAI API Key

- 或其他 OpenAI 兼容接口

硬件建议:

- 内存:4GB 以上

- 存储:取决于文档量(IndexedDB 通常 50MB-500MB)

- 网络:稳定的互联网连接(调用 API)

费用说明

系统本身:

- ✅ 完全免费

- ✅ 无广告、无跟踪

使用成本:

- 💰 API 调用费用(按使用量计费)

- Embedding:约 $0.003 / 1000 tokens

- GPT-4o:约 $0.008 / 1000 tokens

- 📊 成本估算:

- 处理 100 页 PDF:约 $0.1-0.3

- 一次对话(10 轮):约 $0.03-0.1

🎓 结语

DKAI-RAG 不只是一个工具,它是你的智能知识伴侣。

在这个信息爆炸的时代,我们每天面对海量的文档、论文、书籍和资料。传统的阅读和整理方式已经无法应对这个挑战。DKAI-RAG 通过 AI 技术,让你能够:

- 🎯 快速定位 – 从 1000 页文档中秒速找到答案

- 🧠 深度理解 – 不只是搜索,而是真正理解语义

- 🔗 发现关联 – 看到隐藏在文字背后的知识网络

- 💡 激发灵感 – 在对话中产生新的思考

- 🔒 保护隐私 – 你的数据,永远属于你

无论你是学生、研究者、创业者,还是知识工作者,DKAI-RAG 都能成为你最得力的助手。

现在就开始,让你的知识库活起来!

DKAI-RAG – 让知识会思考

Made with ❤️ by DKAI Team

暂无评论内容